自然語言處理與對話技術(shù)研究進(jìn)展及個人思考

自然語言處理(NLP)作為人工智能領(lǐng)域的重要分支,近年來在人機(jī)對話技術(shù)驅(qū)動下取得顯著進(jìn)展。本文結(jié)合個人研究經(jīng)驗,探討NLP技術(shù)的演進(jìn)脈絡(luò)、現(xiàn)狀挑戰(zhàn)與未來方向,并分享在數(shù)據(jù)處理與存儲服務(wù)方面的實踐思考。

一、自然語言處理技術(shù)發(fā)展脈絡(luò)

自然語言處理技術(shù)經(jīng)歷了從規(guī)則驅(qū)動到統(tǒng)計建模,再到深度學(xué)習(xí)的三次范式變遷。早期基于詞典和語法規(guī)則的符號主義方法受限于語言復(fù)雜性,難以處理歧義與多樣性。21世紀(jì)初統(tǒng)計學(xué)習(xí)方法興起,通過隱馬爾可夫模型、條件隨機(jī)場等算法顯著提升了詞性標(biāo)注、命名實體識別等任務(wù)的性能。2013年后,以Word2Vec為代表的詞向量技術(shù)將語義信息編碼為稠密向量,為深度學(xué)習(xí)方法奠定基礎(chǔ)。2018年BERT模型突破性采用Transformer架構(gòu)與預(yù)訓(xùn)練-微調(diào)范式,在GLUE等基準(zhǔn)測試中刷新多項記錄,標(biāo)志著NLP進(jìn)入預(yù)訓(xùn)練大模型時代。

二、人機(jī)對話技術(shù)的關(guān)鍵突破

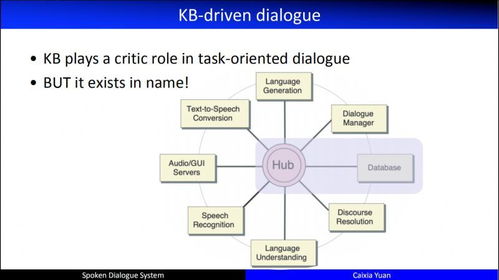

人機(jī)對話系統(tǒng)可分為任務(wù)導(dǎo)向型與開放域?qū)υ拑纱箢悇e。任務(wù)型對話通過意圖識別、槽位填充等技術(shù)實現(xiàn)精準(zhǔn)服務(wù),已在客服、智能家居等場景規(guī)模化落地。開放域?qū)υ拕t更注重語義理解與生成質(zhì)量,GPT系列模型通過自回歸生成實現(xiàn)了上下文連貫的多輪對話。值得關(guān)注的技術(shù)進(jìn)展包括:

- 跨模態(tài)對話融合視覺、語音等多模態(tài)信息

- 知識增強(qiáng)對話通過外部知識庫提升回答準(zhǔn)確性

- 情感感知技術(shù)使對話系統(tǒng)能識別用戶情緒并調(diào)整響應(yīng)策略

- 持續(xù)學(xué)習(xí)機(jī)制讓系統(tǒng)在使用過程中不斷優(yōu)化對話能力

三、數(shù)據(jù)處理與存儲的技術(shù)實踐

高質(zhì)量數(shù)據(jù)是NLP模型的基石。在數(shù)據(jù)采集階段需注重:

- 多源數(shù)據(jù)融合:整合結(jié)構(gòu)化與非結(jié)構(gòu)化數(shù)據(jù)

- 數(shù)據(jù)標(biāo)注策略:結(jié)合主動學(xué)習(xí)與眾包標(biāo)注提升效率

- 隱私保護(hù)機(jī)制:采用差分隱私、聯(lián)邦學(xué)習(xí)等技術(shù)

數(shù)據(jù)存儲層面,建議采用分層存儲架構(gòu):

- 熱數(shù)據(jù)使用內(nèi)存數(shù)據(jù)庫支撐實時對話

- 溫數(shù)據(jù)通過分布式文件系統(tǒng)存儲訓(xùn)練樣本

- 冷數(shù)據(jù)歸檔至對象存儲降低成本

在SegmentFault等技術(shù)社區(qū)實踐中,我們構(gòu)建了基于Elasticsearch的語義檢索系統(tǒng),支持千萬級技術(shù)文檔的智能問答,通過向量化存儲實現(xiàn)毫秒級相似度匹配。

四、挑戰(zhàn)與未來展望

當(dāng)前技術(shù)仍面臨諸多挑戰(zhàn):

1. 少樣本學(xué)習(xí):如何降低對標(biāo)注數(shù)據(jù)的依賴

2. 可解釋性:增強(qiáng)模型決策過程的透明度

3. 倫理對齊:避免生成有害內(nèi)容與偏見放大

4. 能耗優(yōu)化:降低大模型訓(xùn)練與推理的資源消耗

未來發(fā)展方向可能集中于:

- 構(gòu)建具身智能實現(xiàn)與現(xiàn)實世界的交互理解

- 發(fā)展因果推理能力超越相關(guān)性學(xué)習(xí)

- 探索神經(jīng)符號融合的新范式

- 推動輕量化模型在邊緣設(shè)備的部署

自然語言處理正從感知智能邁向認(rèn)知智能,人機(jī)對話技術(shù)將深度重塑人機(jī)交互范式。作為研究者,我們既要擁抱技術(shù)革新,也需保持對技術(shù)倫理的審慎思考,在數(shù)據(jù)處理、模型研發(fā)與應(yīng)用落地間尋求平衡,最終構(gòu)建真正理解人類意圖的智能對話系統(tǒng)。

如若轉(zhuǎn)載,請注明出處:http://m.phototop.com.cn/product/28.html

更新時間:2026-04-14 22:48:01